소프트웨어 개발 과정에서 개발자들은 더 많고 정확한 코딩을 위해 AI 코딩 어시스턴트를 사용하고 있다. 많은 경우 어시스턴트는 입력된 데이터를 수집해 이를 훈련 데이터셋에 기록하는데, 비밀번호나 다른 비밀 정보를 LLM로 전달하면 비밀 정보가 오픈 소스 모델의 훈련 데이터셋의 일부가 될 수 있어 이에 개발자들에게 각별한 주의가 요구된다.

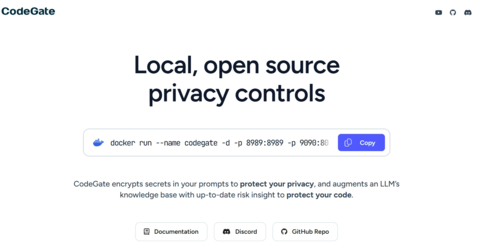

글로벌 AI 보안 기업 스택로크(Stacklok)가 AI 코딩 어시스턴트를 사용하는 소프트웨어 개발자의 개인정보 컨트롤을 지원하는 오픈소스 AI 코딩 어시스턴트 ‘코드게이트(CodeGate)’를 출시했다.

코드게이트는 AI 코딩 어시스턴트와 대형 언어 모델 사이에 위치한 단일 경량 컨테이너로, 모델에 도달하기 전 비밀 정보를 식별하고 암호화하며, 반환 시 비밀 정보를 복호화한다.

한편, LLM의 훈련은 12개월 이상이 지나 종료된다. 따라서 폐기되었거나 새로 파악된 위험에 대한 최신 지식을 가질 수 없으며, 이러한 고위험 종속성을 코드에 추천하거나 병합할 수 있다.

코드게이트는 이를 보완하기 위해 새로 알려지거나 폐기된 악성 패키지를 지속적으로 업데이트해 데이터베이스의 최신 상태를 유지한다. 특히, RAG를 사용해 최신 보안 정보를 제공하며 위험한 패키지 사용을 차단한다.

스택로크의 루크 하인즈(Luke Hinds) CTO는 “현재 90% 이상의 개발자가 AI 코딩 어시스턴트를 사용하고 있으며 많은 경우 데이터를 수집하고, 비밀번호나 다른 비밀 정보를 가져가 대형 언어 모델에 전달한다.”라며 “우리는 개발자들에게 가치를 제공하는 중요한 출발점으로 비밀 정보의 사고 노출을 방지하기 위해 코드게이트를 구축했다.”라고 말했다.

관련기사

- 기업 IT 현대화 비용 문제 해결사 ‘핀옵스 CoE’...‘AI 활용·클라우드 운영 효율’↑

- 개발 속도와 품질이 향상되는 AI 코딩 에이전트

- IBM, '고성능 AI 모델 그래니트 3.0' 출시...투명성·안전성·신뢰성 강화로 비즈니스 최적화

- API 검색과 사전 보안 테스트 통합

- 보안 강화된 임베디드 분석 오픈소스 BI 플랫폼...기업 데이터 활용 극대화

- “소수 개발자에 의존하는 오픈소스, 공급망 공격 주요 타깃”

- 다올티에스-레인보우브레인, RAG·sLLM 사업 확대 협력 강화

- “기업 리더의 90%가 AI 기반 사이버 보안 솔루션 못 믿어”

- 앱섹팀 희소식 ‘자연어 코드 정책’…애플리케이션 보안 시간 절약 및 위험감소

- 데이터 자동 검증하는 오픈소스 ‘LLM 평가 솔루션’...‘RAG 기반 환각 감지·쌍별 선호도 판단·개인정보 보호 지원’

- C/C++ 개발자 지원 ‘비주얼 스튜디오 생성AI 에이전트’...규정 준수 간소화·보안성 강화

- 통합 개발 환경 단위 테스트 지원 차세대 AI 코딩 에이전트

- LG CNS, 시스템 개발 전 과정에 ‘AI’ 도입

- AI 기반 실시간 창작 플랫폼, '인터랙티브 코딩' 대중화 이끈다