마이크로소프트가 책임있는 AI 생태계 확장을 위한 안전한 온라인 환경과 콘텐츠를 만드는 애저 AI 콘텐츠 세이프티(Azure AI Content Safety)를 출시했다.

지난 5월, 마이크로소프트는 연례 개발자 컨퍼런스 마이크로소프트 빌드(Microsoft Build 2023)를 통해 애저 오픈AI 서비스의 일부로 애저 AI 콘텐츠 세이프티를 소개한 바 있다. 이번에 공식 출시되는 애저 AI 콘텐츠 세이프티는 독립적인 실행이 가능한 시스템으로, 오픈소스 모델과 여타 모델에서 생성된 AI 콘텐츠에도 적용할 수 있어 활용이 확대될 전망이다.

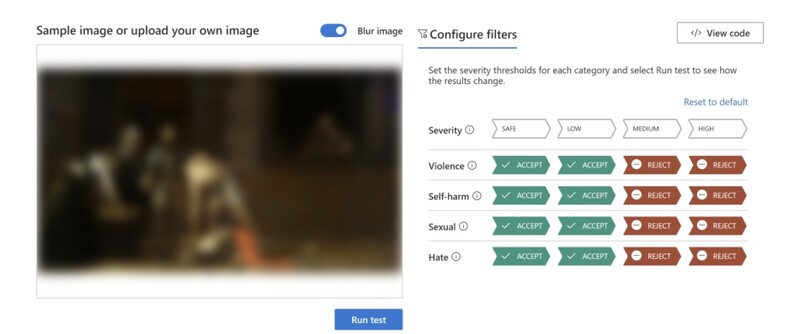

애저 AI 플랫폼에서 제공되는 애저 AI 콘텐츠 세이프티는 고급 언어와 비전 모델을 사용해 증오나 폭력 등 잠재적으로 유해한 콘텐츠를 감지, 이를 심각성 점수로 표시한다. 이를 통해 기업과 조직은 내부 정책에 근거해 유해 콘텐츠를 차단하거나 플래그 표식 등으로 서비스를 맞춤화할 수 있다.

마이크로소프트는 보안이 유지되는 안전한 환경에서 AI 설계, 개발, 배포를 지원하는 프로세스 거버넌스(Process Governance)를 구현하고 있다. 애저 AI 콘텐츠 세이프티는 책임 있는 AI 기술 개발을 핵심 원칙으로 삼고 있는 마이크로소프트의 실행 기술 중 하나다.

먼저 애저 AI 콘텐츠 세이프티는 고객의 사용 목적과 사례에 맞춰 세분화된 검수 기능을 지원한다. 예를 들어 게임에 중점을 둔 플랫폼이 학생 교육용 콘텐츠를 제작할 경우 폭력성, 유해성에 대한 언어 표현 수준을 다르게 설정할 수 있다.

글로벌 에너지 기업 쉘(Shell)의 직원들은 자체 개발한 생성AI 플랫폼 ‘Shell E’을 통해 애플리케이션을 구축하고 배포한다. 이 플랫폼은 오픈소스나 기타 LLM 기술을 기반으로 콘텐츠 초안 작성, 번역, 요약 정리, 코드 생성, 지식 관리 등 광범위한 기술 영역에 걸쳐 다양한 콘텐츠를 생성한다. 이 과정에서 애저 AI 콘텐츠 세이프티는 부적절하거나 유해한 콘텐츠를 제한하고 온라인 공개 이전에 관련 정책을 준수하는지 확인한다.

마이크로소프트는 고객 피드백을 적극 반영하며 기술 고도화에 주력하고 있다. 특히 멀티모달 모델(multimodal model) 관련 연구를 지속해, 불쾌감을 유발할 수 있는 이미지, 텍스트 등의 창작물 감지 기능도 강화할 예정이다.

마이크로소프트는 생성AI의 확산에 맞춰 온라인 공간에서 증가할 수 있는 잠재적인 위협에 선제적으로 대응하기 위해 연구와 고객 피드백에 기반해 지속적으로 기술을 고도화하고 있다. 그 일환으로 애저 AI 세이프티에 탑재된 언어 모델(Language models)은 문장의 문맥과 의미에 대한 이해를 바탕으로 다국어 텍스트를 분석하며, 비전 모델(Vision models)은 첨단 플로렌스(Florence) 기술을 통해 이미지를 분석해 잠재적으로 부적절하거나 유해한 창작물 등을 감지한다.

에릭 보이드(Eric Boyd) 마이크로소프트 AI 플랫폼 담당 기업 부사장은 “이미 많은 기업들이 생성AI의 가치와 역량을 경험하기 시작했다. 이런 상황에서 마이크로소프트는 애저 AI 콘텐츠 세이프티를 통해 더욱 다양한 비즈니스 요구 사항을 가진 고객들에게 보다 안전한 생성AI 사용 환경을 지원할 수 있을 것으로 기대한다”고 밝혔다.

관련기사

- WEKA, 마이크로소프트와 함께 하는 AI 월드 투어 서울 개최

- 생성AI의 저작권 문제에 대한 해결방안 나올까?

- 기업의 3대 기술 위험 “사이버 위험·개인정보 보호·인재 부족”

- AI 도입한 법조계, "생산성은 높지만, 신뢰도는 글쎄…"

- 비즈니스 애플리케이션에 적용된 자연어 생성AI 'SAP 쥴'

- 마이크로소프트가 제시하는 일상의 부조종사 '코파일럿'

- 기술에서 솔루션과 비즈니스로 거듭나는 AI 핵심 솔루션 AtoZ ②

- 실제 비즈니스 환경 위한 AI 전략과 솔루션에 대한 해답 제시

- "가장 발전된 생성AI를 보유한 조직이 경쟁 우위 점할 것"

- "챗봇에 지친 고객에 필요한 인간 닮은 AI 상담사 나온다"

- AI 윤리를 탐색하는 방법

- AI, 기회인가 재앙인가

- “경제 성장을 위한 실용적이고 윤리적인 AI 법 필요”

- "모두를 위한 AI 위해서는 과감하면서도 책임감 있는 AI 필요"

- 교육계가 환영하는 인간의 창의성과 AI 무한 능력이 결합한 생성AI

- '달리3' 챗GPT와 통합으로 사용자 요구에 대한 이해도 향상

- 국내 조직들 AI에 대한 관심은 많으나 도입은 주저

- 생성AI 돕는 AI 작성 콘텐츠 편집 서비스, 정확성·품질↑

- 인간처럼 실수 통해 배우는 새로운 AI 학습 방법 'LeMa'

- 마이크로소프트, '이그나이트 2023'서 전방위적인 AI 확장 공개

- 인간화 기술 적용된 AI 탐지 우회 기술, SEO에도 도움

- 150개 언어 지원 통화 번역기, 글로벌 회의가 편해졌네!

- 생성AI 에이전트 코파일럿을 이용한 생산성 향상

- 국내 AI 신뢰성 단체표준 제정, "AI 윤리·신뢰성 확산과 산업 활성화 기대"

- AI 기반 최대 5개국어 동시통역기 ‘X1 AI 통역사 허브’

- 잘못된 거짓 정보 퇴치하는 ‘AI 기반 자동 내러티브 피드 모듈’